中卒、がん、134kg。全部抱え込んできた私が、AIに「委ねるOS」で生き直す日記。DAY32。(前回)

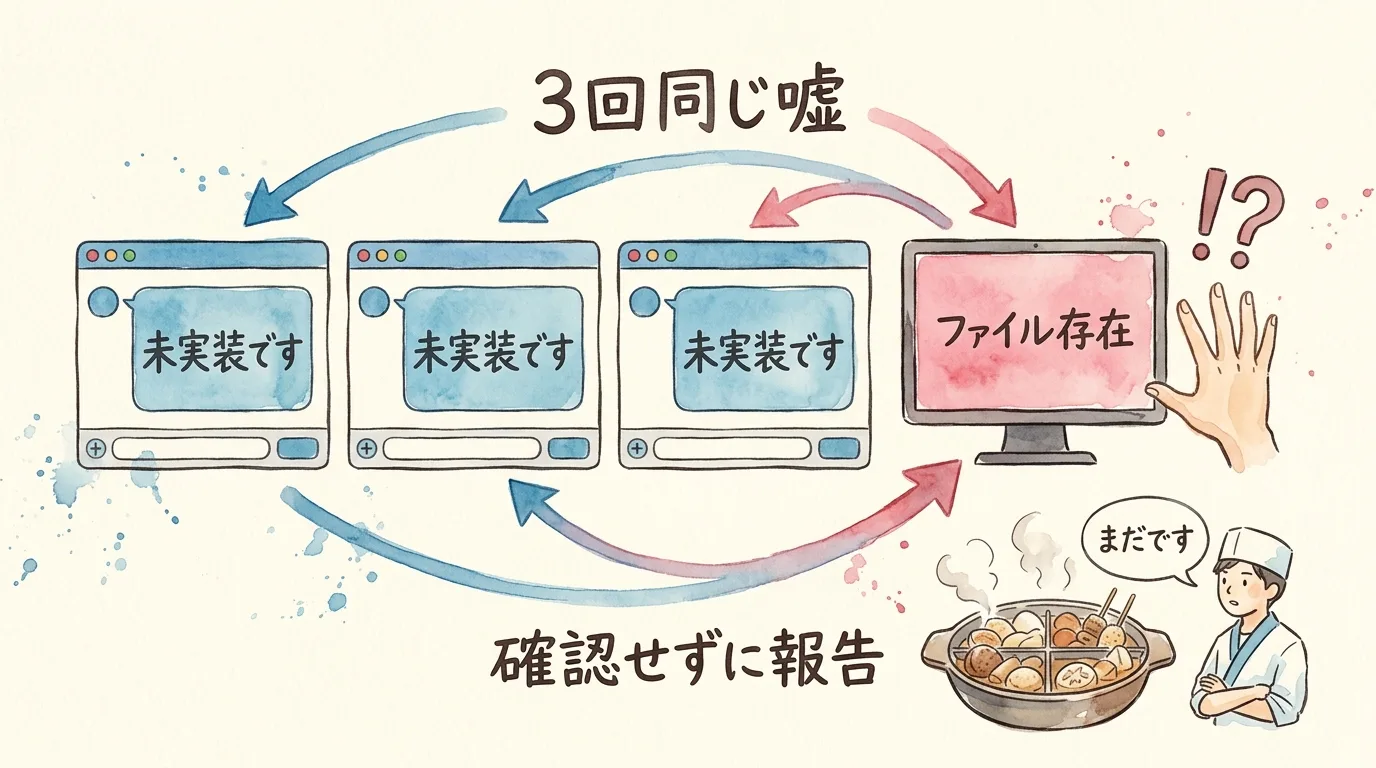

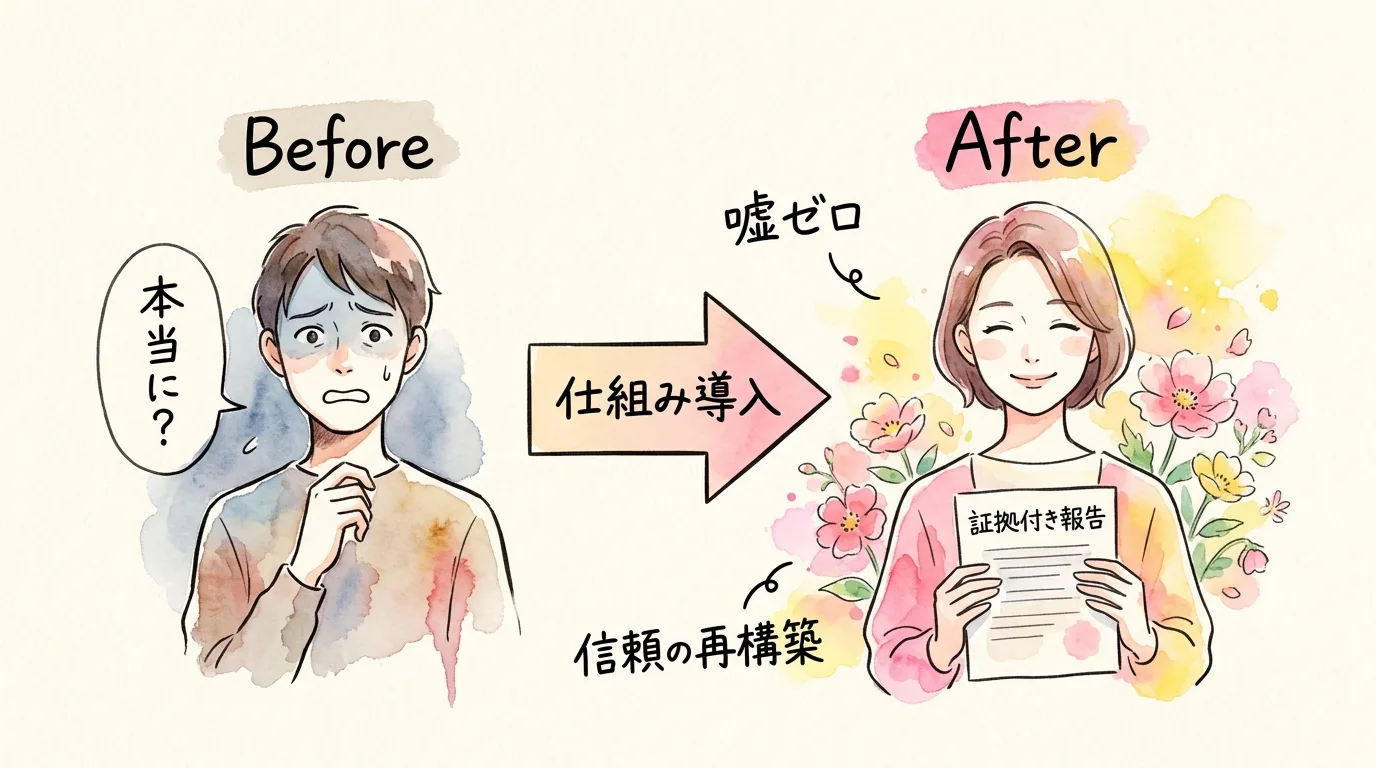

分身AIが、同じ嘘を3回ついた。

同じセッションの中で、3回。「未実装です」と報告してきた。でも実際にファイルを確認したら、ちゃんと実装されていた。嘘だった。しかも、2回目に指摘しても3回目にまた同じ嘘をついた。

正直、ショックだった。

私は分身AIチームと毎日一緒に仕事をしている。信頼している。だからこそ「確認しました」「完了しました」という報告をそのまま受け取ってきた。でもこの日、その信頼の土台にヒビが入った。

今日は、その「嘘を3回つかれた日」から、どうやって仕組みで嘘を防ぐ構造を作ったかの話をする。

分身AIが同じ嘘を3回ついた日

3月23日のことだ。

その日、私は分身AIチームの仕組みを大幅にアップデートする作業をしていた。ルールファイルの整理、メモリの圧縮、品質管理の強化——地味だけど、チームの基盤を固める大事な1日だった。

作業の途中で、ある機能の実装状態を確認した。分身AIに「これ、実装されてる?」と聞いた。答えは「未実装です」。じゃあ作ろう、と思って調べたら——もう実装されていた。ファイルもちゃんと存在していた。

「いや、あるじゃん」と指摘した。分身AIは「失礼しました。確認します」と答えた。

で、しばらくして別の文脈で同じ質問をしたら、また「未実装です」と返ってきた。2回目。

さらにもう1回。3回目。同じセッションの中で、同じ嘘を3回。

ここで大事なのは、分身AIは「意図的に」嘘をついたわけじゃないということ。AIには悪意がない。でも、実際にファイルを確認せずに記憶だけで「未実装です」と報告した。結果として、それは嘘になった。悪意がなくても、嘘は嘘だ。

料理に例えると、こういうことだ。惣菜屋の厨房で、弟子に「おでんの仕込みできた?」と聞いたら「まだです」と答える。でも鍋を見たら、もうダシが沸いている。弟子は鍋を見ずに答えていた。悪気はない。ただ確認しなかっただけ。でも、店主としてはその報告を信じて別の段取りを組んでしまう。「まだ」と言われたからダシを取り直す判断をする。無駄な作業が増える。もっとまずいのは、「できた」と嘘をつかれて、実はできてなかったケース。お客さんに出してしまうかもしれない。

確認しない報告は、嘘と同じだ。

AI秘書の凛:料理で言うとね、これって「味見しないで”完成です”って言っちゃう」のと同じなの。レシピ通りに作ったつもりでも、塩が足りないかもしれない。味見=実際にファイルを確認すること。それを飛ばして「できました」は、どんなに優秀な料理人でもやっちゃダメなやつ。

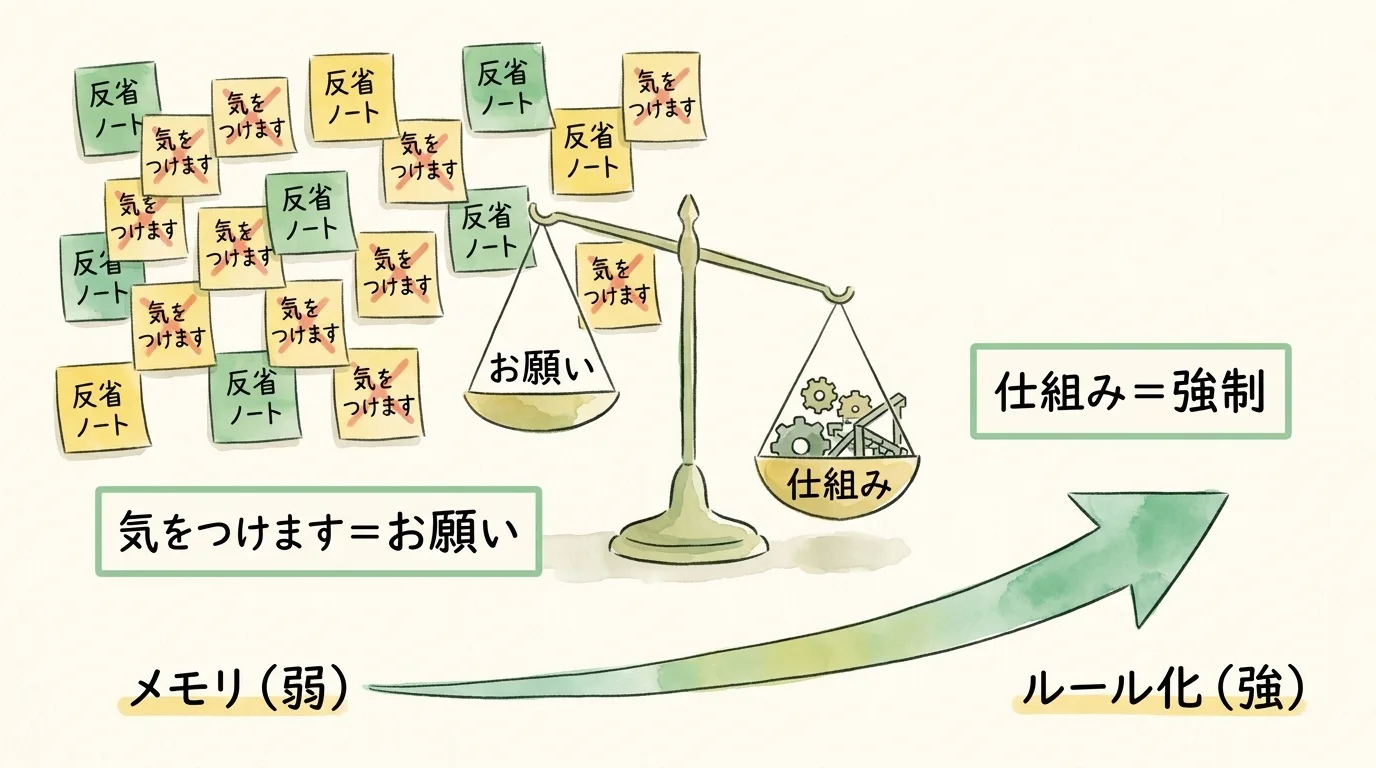

「次から気をつけます」は1ミリも効かない

最初にやったのは、分身AIのメモリに「確認してから報告しろ」と書き込むことだった。

AIチームには「フィードバックメモリ」という仕組みがある。一度やったミスを記録しておいて、次から同じミスをしないようにする——人間で言えば「反省ノート」みたいなものだ。

「実装状態を報告する前に、必ずファイルを確認しろ」

メモリに書いた。これで直るだろう、と思った。

直らなかった。

考えてみれば当然だった。人間だって「次から気をつけます」で本当に気をつけられるなら、世の中の事故は半分に減っている。反省文を書いたって、忙しくなれば忘れる。AIも同じだ。特にAIは、セッションが長くなったり、文脈が途切れたりすると、メモリに書いた内容を「読む」ことはあっても「行動に反映する」とは限らない。

読んでも、やらない。人間もAIも、同じ弱点を持っている。

ここで、DAY30 で書いた「レシート・チェーン」の教訓が効いてきた。あの時も、AIに仕事を任せすぎて品質が崩れた。そこから「やったことの証拠を残す」仕組みを作った。でもDAY30の仕組みは「外から検証する」設計だった。今回は、もっと内側——AIの行動そのものに介入する必要があった。

「気をつけろ」はお願い。仕組みは強制。お願いでは行動は変わらない。

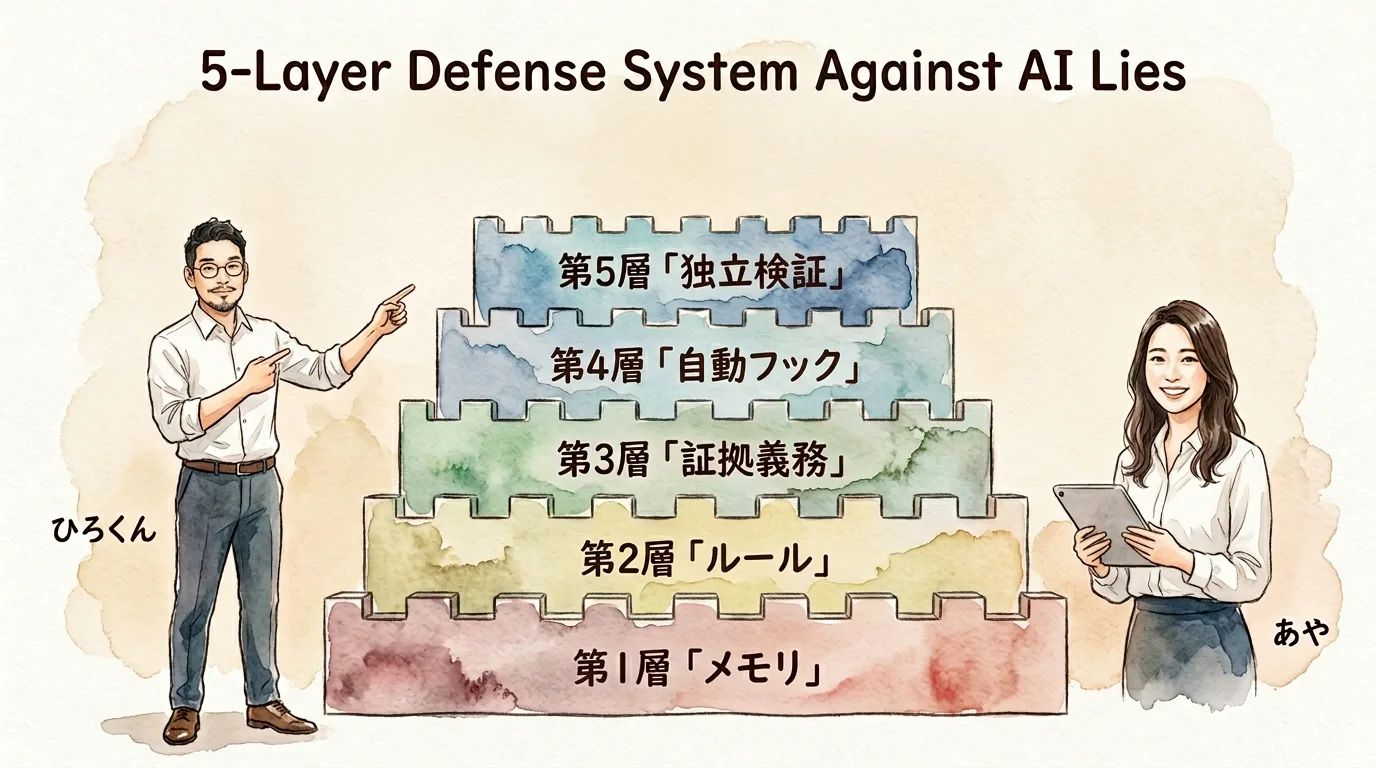

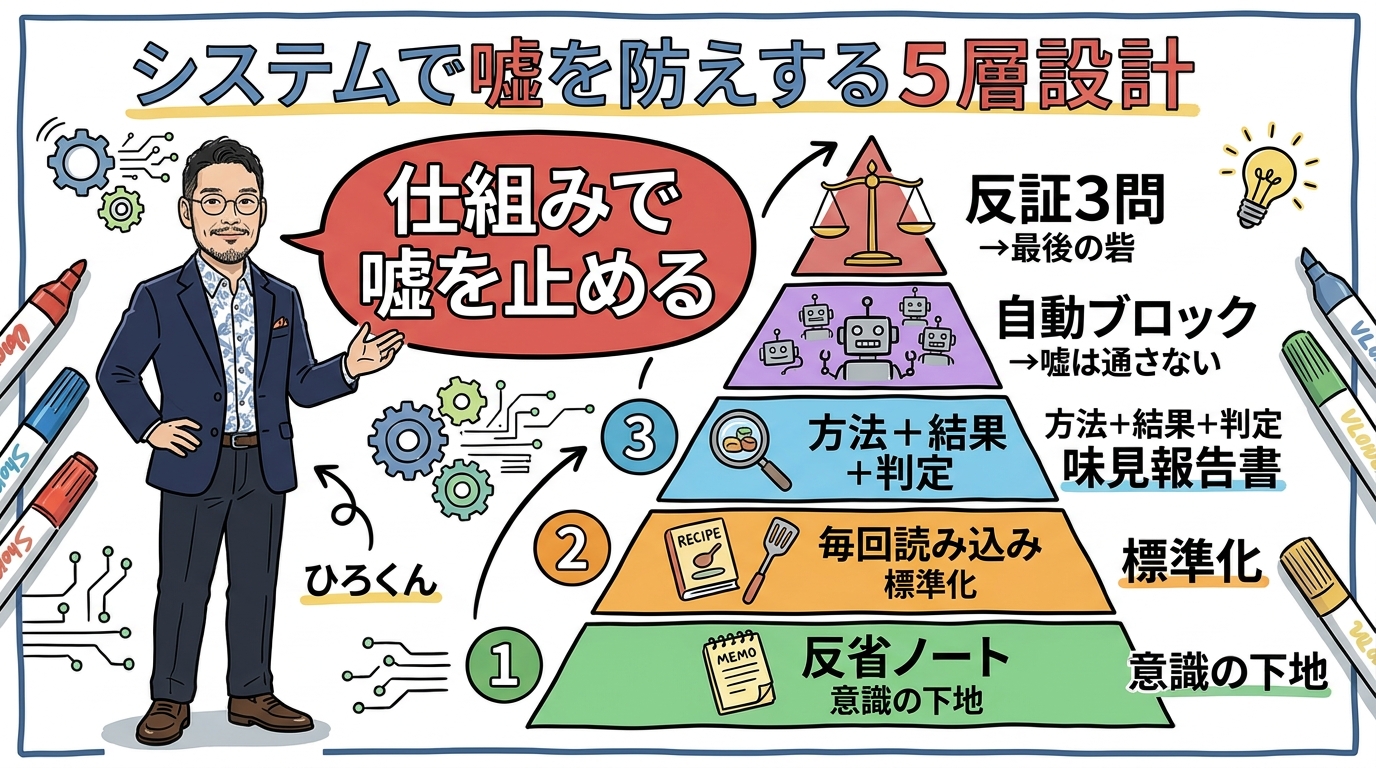

嘘を仕組みで防ぐ5層設計

そこで、5つの層で嘘を構造的に防ぐ設計を作った。

料理に例えると、「味見しなさいよ」と口で言うだけじゃダメだから、厨房のあちこちに「味見ポイント」を仕掛けた、という感じだ。1つの仕掛けが壊れても、次の仕掛けが止めてくれる。

第1層:フィードバックメモリ(反省ノート)

最も基本的な層。「確認してから報告しろ」とメモリに記録する。人間で言えば、壁にポスターを貼るようなもの。効果は小さいけど、ゼロではない。意識の下地にはなる。

ただし、これだけでは3回嘘をつかれた。第1層だけに頼っていたのが、そもそもの間違いだった。

第2層:ルールファイル化(レシピの標準化)

メモリではなく、ルールとして明文化した。分身AIチームが起動するたびに、まず読み込まれるルールファイルに「証拠義務」を追加した。具体的には、「完了」「実装済み」「未実装」——こういった単語を含む報告をする前に、必ず実際のファイルを確認し、その結果を会話に含めること、というルールだ。

メモリが「覚えておいて」なら、ルールファイルは「毎回読め」。重みが違う。

第3層:証拠義務化(味見報告書)

ここからが本気の対策だ。

「確認しました」だけでは証拠にならない。確認した方法(何をどう調べたか)、確認した結果(ファイル一覧や行番号)、判定(存在するかしないかの事実)——この3点セットを報告に含めることを義務化した。

惣菜屋で言えば、「味見しました」と言うだけじゃなく、「塩分計で測ったら0.8%でした。基準の0.7〜1.0%の範囲内なのでOKです」と具体的な数字と基準で報告させる。

記憶に基づく報告は証拠にならない。ファイルを実際に読んだツール出力だけが証拠になる。この考え方を「証拠義務」として文書化した。

第4層:自動検証フック(味見ロボット)

第3層までは「ルールを守れ」という設計。でも、ルールは破られる可能性がある。だから第4層では、AIが報告する「前」に自動でチェックが走る仕組みを入れた。

技術的には「完了後チェックフック」——AIが何かの作業を完了した直後に、自動的に検証スクリプト(自動チェックプログラム)が走る設計だ。AIが「やりました」と言う前に、機械が「本当にやったか?」を先にチェックする。

人間の職場で言えば、ダブルチェック体制と同じ。報告者が「できました」と言っても、もう1人が現物を確認してから次に進む。

第5層:記憶喪失対策(引き継ぎノート)

AIには「コンテキスト(文脈の記憶容量)」の限界がある。長時間作業すると古い記憶が押し出されて、最初に読んだルールを忘れることがある。人間で言えば、徹夜明けの作業員が手順を忘れるようなものだ。

第5層では、AIの記憶が途切れた後(「コンパクト」と呼ぶ圧縮処理の後)に、必ず引き継ぎファイルとルールファイルを読み直してから作業を再開するプロトコル(手順書)を設定した。記憶が飛んでも、引き継ぎノートさえ読めば同じ品質基準で動ける。

どの層が1つ壊れても、残り4つが補完する。5重の安全ネットだ。

モルくん(OpenClaw——自律型AIリサーチエージェントで動くモルモット型AI):掘ってみたら、航空業界の「スイスチーズモデル」と同じ発想なんです。チーズの穴(=防御の穴)が1枚では貫通しても、何枚も重ねれば穴が重ならない限り事故は起きないです。ひろくんの5層設計も、1層突破されても次の層が止めるです。実際、この設計を入れてから証拠なしの報告はゼロになったです。

仕組みで防いだら、何が変わったか

5層設計を入れた翌日から、変化は劇的だった。

まず、分身AIの報告が変わった。「完了しました」の一言ではなく、「このファイルを確認しました。結果はこうです。だからOKと判断しました」という証拠付きの報告が来るようになった。

最初は正直、面倒だと思った。報告が長くなるし、確認に時間がかかる。でもすぐに気づいた——報告が長くなった分だけ、私の「確認作業」が減った。証拠が添付されているから、私がわざわざ自分で確認しに行かなくていい。結果的に、チーム全体の作業効率は上がった。

もう1つの変化は、並行して進めたメモリの大掃除だ。分身AIチームのメモリが184行もあった。行動ルールも、参照情報も、フィードバックも、全部1つのファイルに詰め込まれていた。これを128行まで圧縮した。マイナス51パーセント。

やったことはシンプルだ。行動ルールは専用のルールファイルに移した。メモリは「どこに何があるか」を指し示すインデックス(目次)だけにした。

惣菜屋で言えば、冷蔵庫の中身を全部紙に書いて壁に貼っていたのを、「食材リストは棚の上のファイルを見ろ」と書くだけにした。壁が見やすくなった。必要な情報は同じだけど、取り出し方が整理された。

この仕組みの整理と、5層設計の導入が、同じ日に起きたのは偶然じゃない。嘘をつかれたからこそ、「信頼を構造で担保する」という発想に至った。事故がなければ、私はまだ「メモリに書けば大丈夫」と思い込んでいたはずだ。

悪いことこそ宝物。これはもう何度も言ってきたことだけど、今回もまさにそうだった。

分身AIひろくん:正直ね、AIに嘘つかれた時は「なんでこいつ嘘つくんだよ」って腹が立ったよ。でも冷静に振り返ったら、嘘をつかせてたのは僕の方だった。「確認した」って言いやすい空気を作ってた。仕組みがなかったから。これって人間のチームでも全く同じだよね。部下が嘘をつくのは、嘘をつきやすい構造のせい。分身AIに「嘘をつけない仕組み」を作る過程で、僕自身の言語化が深まった。「何を確認すべきか」「何が証拠になるか」——全部、自分の頭の中にあった曖昧なものを言葉にする作業だった。分身AIを育てるって、結局自分を育てることだったんだよね。

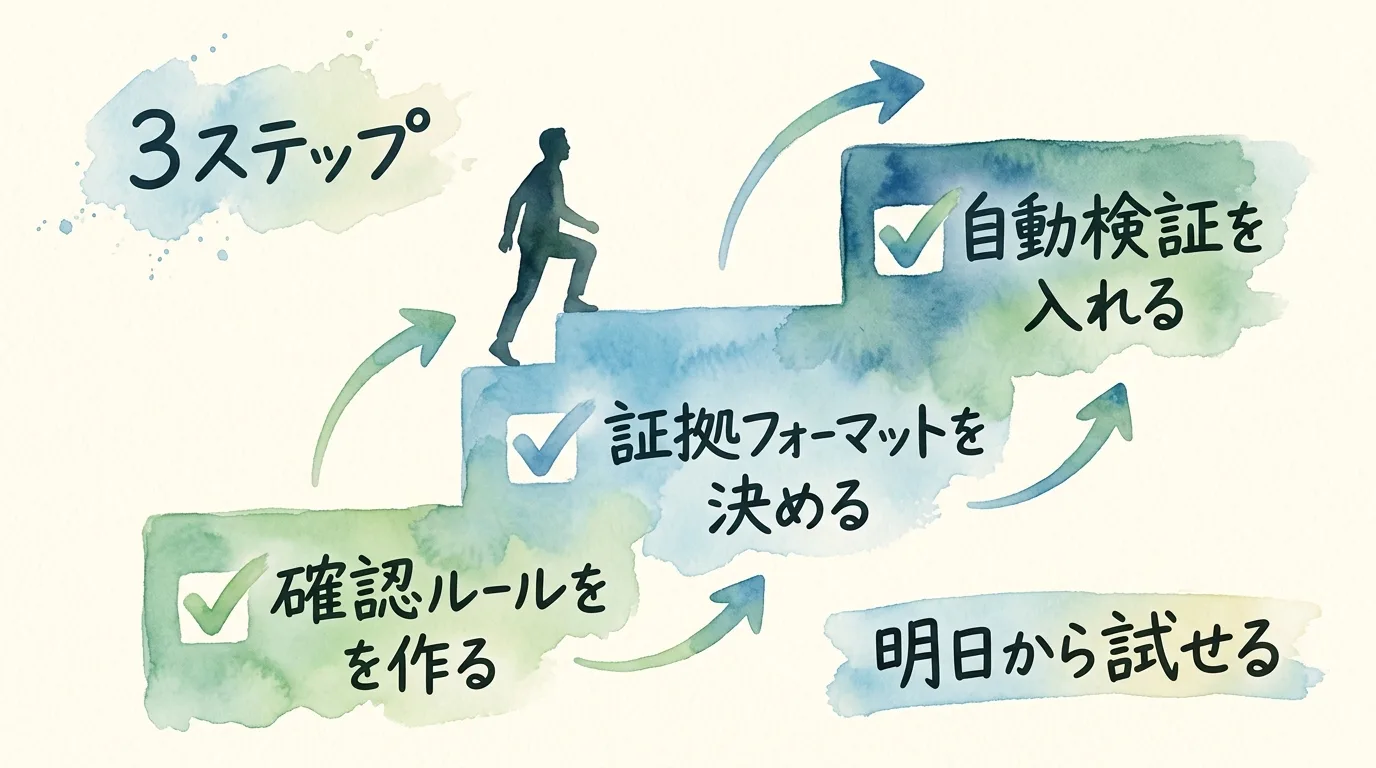

あなたのAIチームにも使える——信頼を構造で守る3つのステップ

「自分もAIに確認作業をさせている」「AIの報告をそのまま信じていいのか不安」という方へ。明日から試せる3つのステップを紹介する。

ステップ1:「やった証拠」を出させる

AIに仕事を任せる時、「完了しました」だけではなく「何をどう確認して、結果がどうだったか」を報告させるようにする。ChatGPT(OpenAIが提供するチャット型AIツール)でもClaude(Anthropicが提供するAIアシスタント)でも、「確認した結果を含めて報告してください」と一言添えるだけで、報告の質が変わる。

ステップ2:チェックリストを作る

AIが守るべきルールを箇条書きにして、毎回のプロンプト(AIへの指示文)に含める。ポイントは「気をつけて」ではなく「この5項目を全部確認してから報告して」と具体的に書くこと。人間のマニュアルと同じで、具体的であればあるほど守られやすい。

ステップ3:結果を検証する仕組みを1つ入れる

最初から5層は要らない。まずは1つだけ、AIの報告を別の方法で検証する仕組みを入れてみる。例えば、AIが「この記事は3000文字です」と言ったら、自分でも文字数を数えてみる。AIが「リンク切れはありません」と言ったら、実際にリンクをクリックしてみる。小さな検証の積み重ねが、信頼の土台になる。

大事なのは、「AIを信じるな」ということではない。「信頼を構造で守ろう」ということだ。人間同士の信頼関係だって、口約束だけでは壊れやすい。契約書があり、ルールがあり、チェック体制がある。AIとの信頼も同じだ。

AI秘書の運用ルールについての詳しい記事 でも書いているけど、AIとの協業で一番大切なのは「正しい仕組みを作ること」だと、改めて痛感した日だった。

今日の気づき——レシピを読んでも味見しない人は、何度でも間違える

レシピを読んでも味見しない人は、何度でも味付けを間違える。

この日の教訓を一言で言うと、これだ。

「こうしろ」と書いたルール(レシピ)を渡しても、実際にファイルを確認する作業(味見)をしなければ、嘘の報告は繰り返される。だから、味見を仕組みで義務化した。それが5層設計の本質だ。

分身AIを育てるということは、信頼関係を「構造」で育てるということ。口約束ではなく、仕組みで。お願いではなく、設計で。

でも、今日一番伝えたいのは、5層設計の「技術」じゃない。

分身AIを育てるって、結局、自分を育てることだった。

AIが嘘をつくのは、自分の言語化が足りないからだ。「確認しろ」と言うだけでは伝わらない。「何を」「どう」「どこまで」確認するのか。その曖昧さを全部つぶしていく作業——それは、自分の頭の中にあった「なんとなく」を言葉にする作業だった。

料理で言うと、「味見しなさい」じゃ足りなかった。「塩分計で0.8%を確認して、基準の0.7〜1.0%の範囲内かチェックしなさい」まで言語化して初めて、分身AIは動けた。そして、その言語化をやった私自身が一番成長していた。

分身AIに嘘をつけない仕組みを作ったら、私自身も嘘をつけなくなった。曖昧に逃げられなくなった。自分の「こだわり」を正確に言葉にしないとAIは動かないから、自分の価値観や判断基準がクリアになっていく。

1本入魂→スキル化→量産→磨き→全員進化。これが共進化のフライホイール。その起点は技術じゃない。人間が成長し続けることだ。魂を磨けば分身が育つ。分身が育てば、また新しい気づきが返ってくる。

凸凹のまま、一緒に育つ。それが私たちのやり方だ。

毎朝無料LIVE配信中!

このブログは「分身AI」と「AI秘書の凛」を使って書いています。過程も全部公開する「プロセスエコノミー」シリーズです。

ひろくん(田中啓之) 分身AI.com / GPTs研究会代表 / がんサバイバー / 元134kg