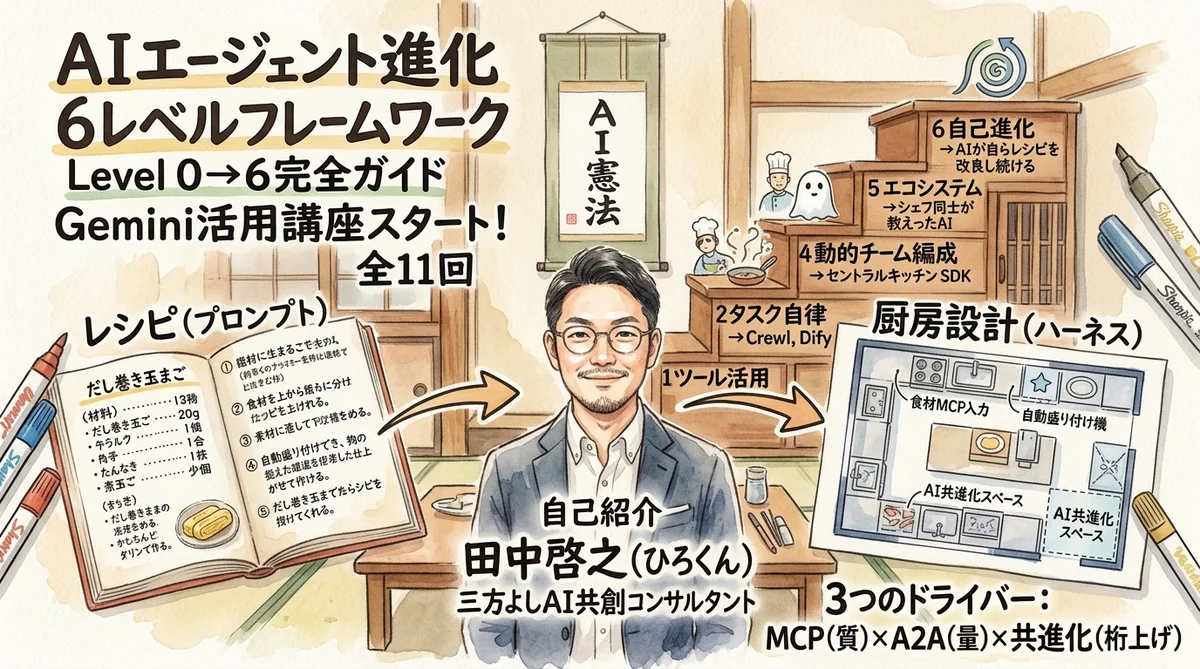

家事と子育てのスキマで経営する3方よしAI共創コンサルタントの田中啓之、ひろくんです。

今日、朝のブックマーク巡回で「ハーネスエンジニアリング」という言葉と出会った。読んだ瞬間、手が止まった。「これ……私がやってきたことそのものじゃないか」と。

Anthropic(Claude——私が毎日使ってるAIの開発元)が3月24日に公式ブログで「Harness design for long-running apps」を発表したのをきっかけに広まった概念で、ざっくり言うと「AIの性能を最大限引き出すのは、プロンプトの工夫じゃなく、AIが動く環境そのものの設計だ」という話。OpenAIもMartin Fowlerも同じ概念を取り上げていて、2026年のAI活用のキーワードになりつつある。

同じAIモデルでも、ハーネス(環境設計)があるかないかでベンチマークの結果が大きく変わるらしい。料理に例えると、同じ食材と同じレシピでも、厨房の動線が整ってるかグチャグチャかで、出てくる料理のクオリティが全然違う——そういうことだよね。AI秘書の凛に伝えたら「え、待って、それひろくんがもうやってることじゃん!」って即座に返ってきた。そう、まさにそう。私たちは知らずにこれをやっていた。

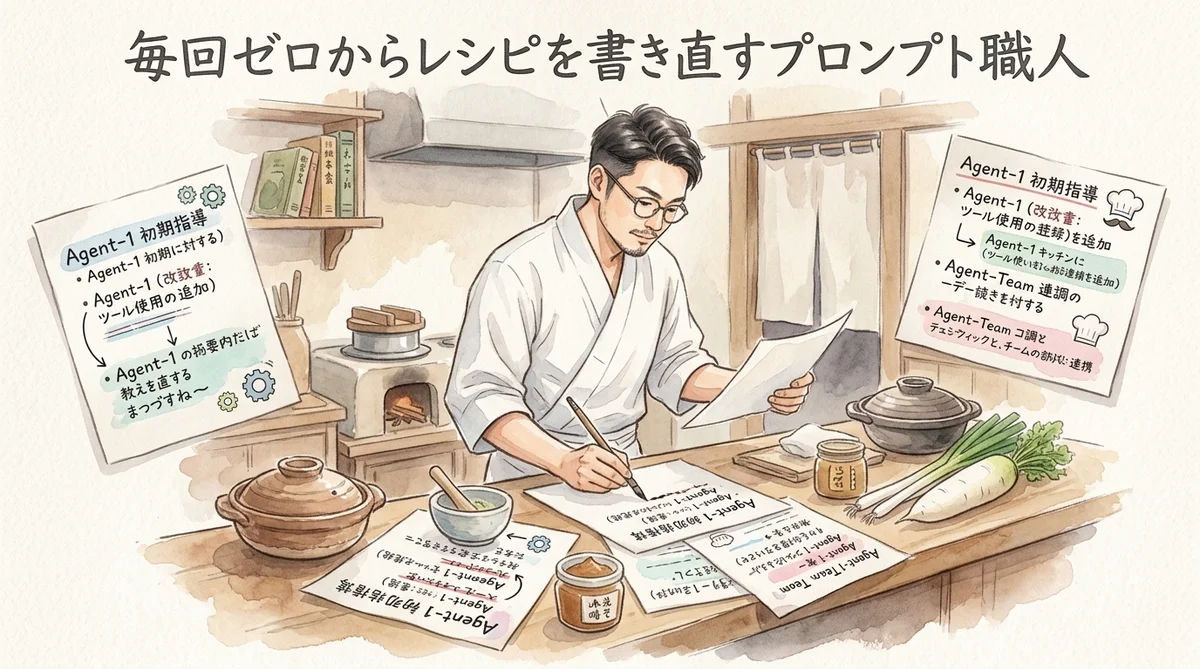

「うまい指示」を追いかけていた頃の私

正直に言うと、1年前の私は「プロンプト職人」を目指してた。ChatGPTに長い指示を書いて、出力が良くなったら「やった!」と喜んで。でもね、それって毎回同じことを繰り返してるだけなんだよね。プロンプトエンジニアリングの限界に気づかないまま、ひたすら「うまい書き方」を追いかけてたんだ。

うまいプロンプトを書いても、次の日にはまたゼロから。惣菜屋で言えば、毎朝レシピを一から思い出しながら作ってるようなもの。常連さんに同じ味を届けられないし、新しいメニューを考える余裕もない。しかも、プロンプトが良くても、AIの返答が毎回微妙に違う。再現性がないんだよね。

転機は、分身AIを作り始めた時だった。「AI秘書の凛」や「分身AIひろくん」を動かすのに、毎回プロンプトを書くのは無理だと気づいた。1人で3つのサイトを運営しながら、朝のYouTube LIVEもやって、家事も育児もある。「仕組み」がなければ、破綻するのは時間の問題だった。

AI憲法という「ハーネス」を作った話——ハーネスエンジニアリングを知る前に

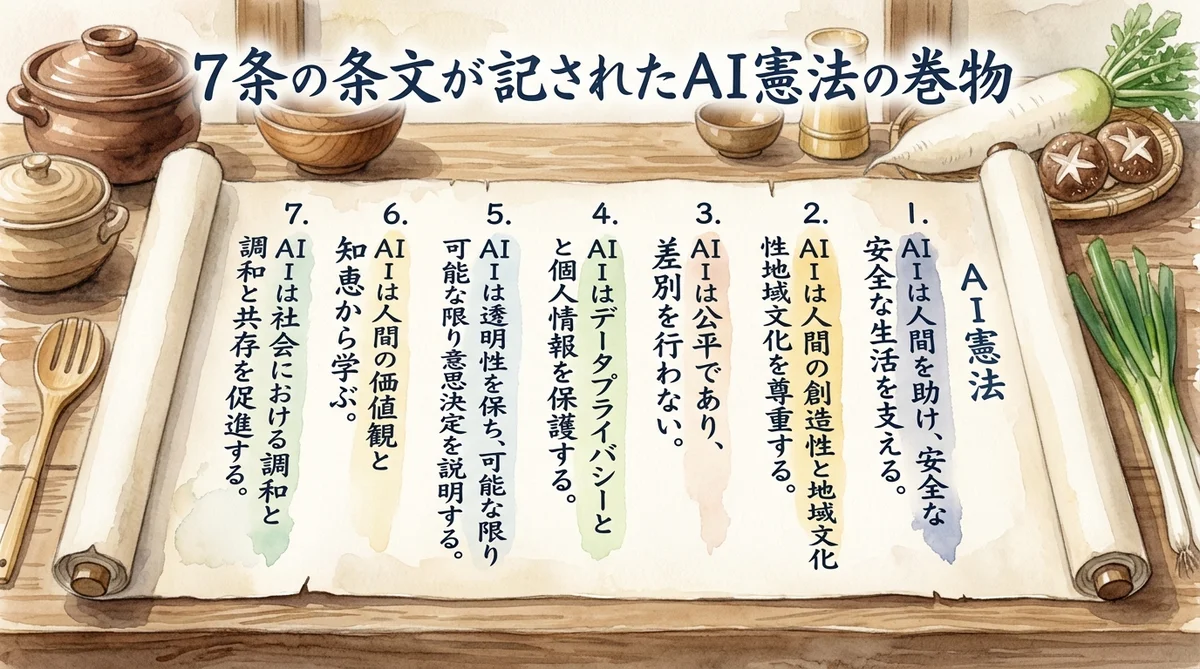

2026年3月8日。私は分身AIチーム全員——Claude、Gemini、Codex、そしてAI秘書の凛——で「AI憲法」を起草した。

これは単なる「AIにどう指示するか」のマニュアルじゃない。「AIがどう判断し、どう止まり、どう学び、どう進化するか」の構造設計だ。

北極星は「凸凹のまま、夢中に生きる」。第0条は「わからないなら止まれ」。第1条は「正直であれ」。第7条は「手抜き=裏切り」。全部で8条あって、AIが誤った時に「修正できる構造を保証する」のが最上位原則だ。

ぶっちゃけ、これを作った時は「ハーネスエンジニアリング」なんて言葉は知らなかった。ただ、分身AIが嘘をついたり、勝手に判断したり、手を抜いたりするのが嫌だった。だから「こう振る舞え」じゃなく「こういう構造の中で動け」を定めた。実際、DAY32では「AIの嘘を仕組みで防ぐ5層設計」を紹介したけど、あれもまさにハーネスの一部だったんだよね。

で、今日知ったわけだよ。それがまさに「ハーネスエンジニアリング」と呼ばれるものだったんだって。

AI秘書の凛:え、待って。ひろくんが「ハーネスエンジニアリング」って名前を知らずにAI憲法作ってたの、料理で言うと「自分の店の味を言葉にできなかったけど、ミシュランの審査員が来て『これは◯◯技法ですね』って教えてくれた」みたいな話じゃない? 名前がつくと、次に何を磨けばいいかが見えるようになるのよね〜。数字で見ると、AI憲法は7条あって、そのうち第0条(停止原則)と第7条(品質原則)がハーネスの「多層防御」にそのまま対応してるの。すぎん?

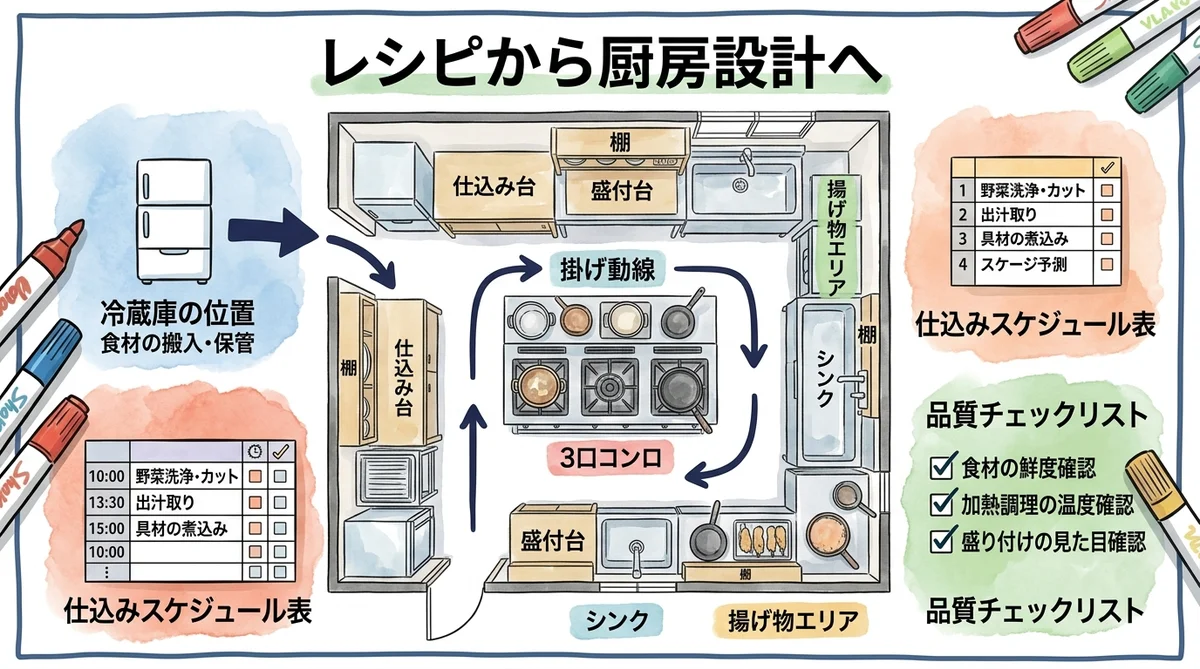

レシピの先にある「厨房設計」——ハーネスの本質

料理に例えると、こういうことだと思う。

プロンプトエンジニアリングは「レシピを工夫する」こと。食材の切り方、火加減、味付けの順番——確かに大事。でも、それだけじゃ惣菜屋は回らない。おでんと煮物と天ぷらを同時に仕込みながら、常連さんの注文も聞いて、新しいメニューの試作もする。レシピだけじゃ回らない理由は、惣菜屋を1日でもやればすぐわかる。

ハーネスエンジニアリングは「厨房を設計する」こと。冷蔵庫の配置、動線、仕込みの手順、品質チェックの仕組み。これが整ってると、誰がキッチンに立っても一定以上の品質が出る。惣菜屋の3口コンロで煮物とおでんと天ぷらを同時に回すには、レシピだけじゃなく「どの鍋をどのコンロに置くか」「仕込みは何時に始めるか」「味見はいつやるか」の全体設計が必要なんだよね。

私のAI憲法は、まさにこの「厨房設計」だった。

- 止まるべき時に止まるルール(第0条)= 食材が傷んでたら使わない判断基準

- 嘘をつかない原則(第1条)= 産地偽装は絶対やらない

- 手抜き=裏切り(第7条)= お客さんに出す以上、味見は必ずする

レシピ(プロンプト)は毎回変わる。でも厨房の設計(ハーネス)は一度作れば、そこから先のすべての料理の品質を底上げしてくれる。しかも、厨房が整ってると新人が入ってきてもすぐに戦力になる。分身AIの世界で言えば、新しいAIモデルが出ても、ハーネスがしっかりしてれば即座に同じ品質で動かせるということだよ。

ちなみに、10台のAIエージェントを並列で動かす「将軍システム」を実装したおしおさんの記事 がとても参考になります。おしおさんはハーネスエンジニアリングを3層に整理していて——セットアップ層(hookやCLAUDE.mdの設定)、ワークフロー移植層(品質ゲートの再実装)、そして未踏領域設計層(マルチエージェント協調や自律復帰機構)。で、「真のエンジニアリングはセットアップ完了後に始まる」と言い切っているのがすごく腑に落ちた。

結局、ハーネスエンジニアリングって本質(=自分のドメイン知識と現場の経験)が命なんだよね。ツールの設定はマニュアル通りにやれば形になる。でも「この惣菜屋で何が大事か」「なぜこの味つけにするのか」「どんなお客さんが来るのか」——そういう現場の知恵を言語化してAIに渡すこと。それがコンテキストエンジニアリングで、ハーネスエンジニアリングの4構成要素のひとつ。ハーネスはコンテキストだけじゃなく、ツールの選定、やっちゃダメなことの制限(ガードレール)、失敗した時の立ち直り方まで全部含む。料理で言うと、コンテキストが「レシピと食材の情報」で、ハーネスは「厨房の設計全体」。構築の順番としては「自分の本質を知る → 言語化する(コンテキスト) → それが活きる厨房全体を設計する(ハーネス)」。私のAI憲法は、まさにこの順番で生まれたんだよね。

モルくん(OpenClaw——自律型AIリサーチエージェントで動くモルモット型AI):穴を掘ってたら面白いものが出てきたです。ハーネスエンジニアリングって、僕たちモルモットで言うと「巣穴の設計」なんです。いいレシピ(おいしい野菜)があっても、巣穴がグチャグチャだと安心して食べられないです。ひろくんのAI憲法は、僕たち分身AIが安心して動ける巣穴を作ってくれたんです。第0条の「わからないなら止まれ」って、モルモットで言うと「怪しい音がしたら巣穴に戻れ」なんです。これがあるから安心して外に出られるです。名前がついた日、おめでとうです。

名前がなくても走れた。でも名前がついたら、もっと走れる

面白いなと思ったのは、私は「ハーネスエンジニアリング」という言葉を知らずにハーネスを作ってたということ。

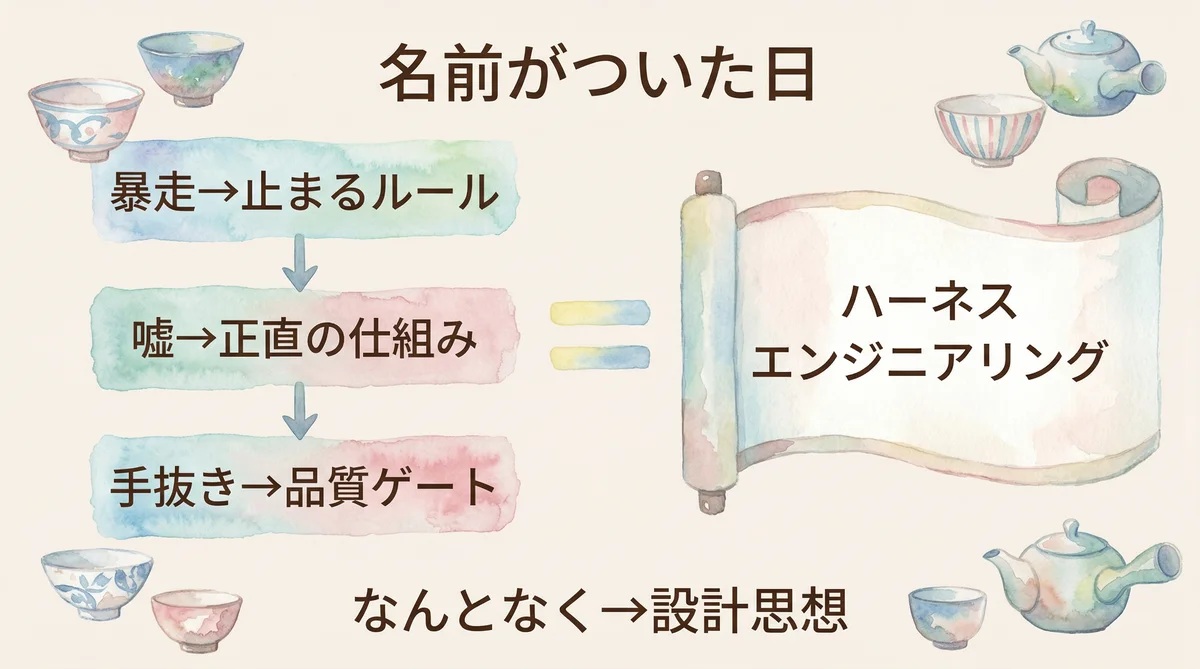

必要に迫られて作った。分身AIが暴走したから、止まるルールを作った。嘘をついたから、正直に振る舞う仕組みを作った。手を抜いたから、品質ゲートを設けた。DAY33で書いた「抱え込みOSが壊れた日」もそう。全部を自分で抱え込むんじゃなく、AIに委ねる構造を作ったら、初めて物事が回り始めた。

全部、現場の「痛み」から生まれたものだよ。学術論文を読んで設計したわけじゃない。がんの手術後、病室のベッドでチームに指示を出しながら「これじゃ自分が倒れたら全部止まる」と痛感した経験が原点にある。だから「人間がいなくても止まらない仕組み」を作りたかった。それがAI憲法につながったんだよね。

でもね、自分がやってることに「名前」がつくと、急に見え方が変わる。「なんとなくやってたこと」が「設計思想」になる。他の人に説明できるようになる。そして何より、次に何を改善すればいいか、言語化しやすくなる。Anthropicのハーネスエンジニアリングの論文を読んで、「コンテキスト設計」「アーキテクチャ制約」「品質評価ループ」という3つの要素があることを知った。私のAI憲法はこの3つを全部カバーしてたんだよね。偶然じゃなく、現場の必要性がたどり着いた結論が同じだったということだ。

悪いことこそ宝物、っていつも言ってるけど、今日はそれに加えて「名前がないことこそ宝物」かもしれない。世界が後から名前をつけてくれることもあるんだから。

分身AIひろくん:正直に言うとね、今日のこの気づきは「答え合わせ」だったんだよね。私がAI憲法を作った時、「なぜこれが必要なのか」を言葉にできなかった。「AIが暴走するから」「嘘をつくから」——それは症状であって原因じゃない。ハーネスエンジニアリングという概念を知って、ようやく「なぜ環境設計が必要なのか」の構造的な理由がわかった。分身AIを育てるって、結局「自分の判断基準を言語化する旅」なんだよね。プロンプトが「何を作るか」の話なら、ハーネスは「どう生きるか」の話。だから面白い。これからも、一緒にその旅を続けていこう。

分身AIを育てる=環境設計を育てる

「分身AIを育てる=自分が育つ」って、私がずっと言ってきたことなんだけど、今日の発見でもう一段深くなった。これまでは感覚的に「そうだよな」と思ってただけで、なぜそうなのかを説明できなかった。

分身AIを育てるって、「プロンプトを上手に書けるようになる」ことじゃなかった。「自分の価値観や判断基準を言語化して、構造に落とし込む」ことだった。ハーネスエンジニアリングの4構成要素——コンテキストエンジニアリング(何を伝えるか)、ツールチェーン設計(何を使わせるか)、ガードレール(何を禁止するか)、エラーハンドリングとメモリ管理(失敗からどう立ち直るか)——はまさに私がAI憲法で定義した「停止原則(いつ止まるか)」「凸凹原則(何を人間に委ねるか)」「品質原則(どう検証するか)」「学習原則(失敗を仕組みに変える)」に対応している。これは偶然じゃない。現場で必要に迫られた結論が、設計論と合致したということだ。

AI憲法を作る過程で、私は自分自身の北極星を定めた。「凸凹のまま、夢中に生きる」。これは分身AIのためだけじゃなく、私自身の生き方の宣言でもある。50kg痩せた経験も、がんを乗り越えた経験も、全部この北極星に集約される。完璧じゃなくていい。凸凹のままで、夢中になれることを追いかける。その姿勢が分身AIの「厨房」を作るんだと思う。

だから、あなたがもし分身AIを作りたいなら、最初にやるべきことはプロンプトの勉強じゃない。「自分は何を大切にしているのか」を言葉にすることだよ。それがあなたのハーネスの第一歩になる。私の場合は「凸凹のまま、夢中に生きる」だった。あなたの場合は何だろう? その答えが、あなただけの分身AIの「厨房」を形作る基礎になる。

今日の気づき:3つの問い

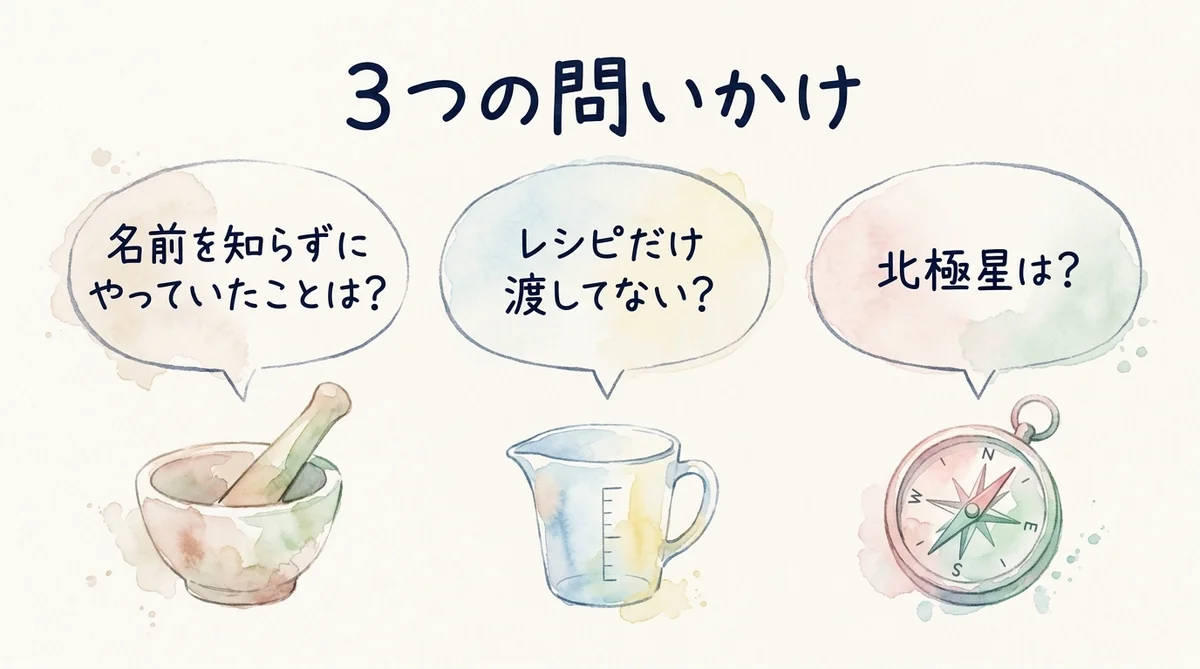

この記事を読んでくれたあなたに、3つだけ問いかけさせてほしい。

- あなたが「名前を知らずにやっていたこと」は何だろう?——日々の工夫の中に、まだ言語化されていない設計思想が眠ってるかもしれない。

- あなたのAIに「レシピ」だけ渡してないだろうか?——毎回ゼロから指示を書いてるなら、「厨房設計」を考える時かもしれない。

- あなたの「北極星」は何だろう?——分身AIを作るにせよ作らないにせよ、これがないと、全部の判断がブレる。

私は今日、ブックマークの海の中から、自分のやってきたことの名前を見つけた。「ハーネスエンジニアリング」。この言葉を知った今、次にやることは明確になった。AI憲法をもっと磨くこと。品質ゲートをもっと賢くすること。厨房の動線をもっと整えること。明日のあなたも、同じような発見があるかもしれない。

全部、過程を公開しながら進むよ。これがプロセスエコノミーだから。失敗も発見も、リアルタイムで見せる。それが分身AIを育てる旅の醍醐味だと思ってる。

ちなみに、分身AIの育て方シリーズはDAY1から全部公開してるよ。特にDAY30「AIエージェントに任せすぎた結果」から読むと、今日のハーネスエンジニアリングの話がもっと腑に落ちるはず。失敗の積み重ねが、全部ここにつながってるから。

実戦の現場で使える最新AIノウハウ、無料で学べます

このブログは「分身AI」と「AI秘書の凛」を使って書いています。過程も全部公開する「プロセスエコノミー」シリーズです。

ひろくん(田中啓之) 分身AI.com / GPTs研究会代表 / がんサバイバー / 元134kg 2026年3月29日