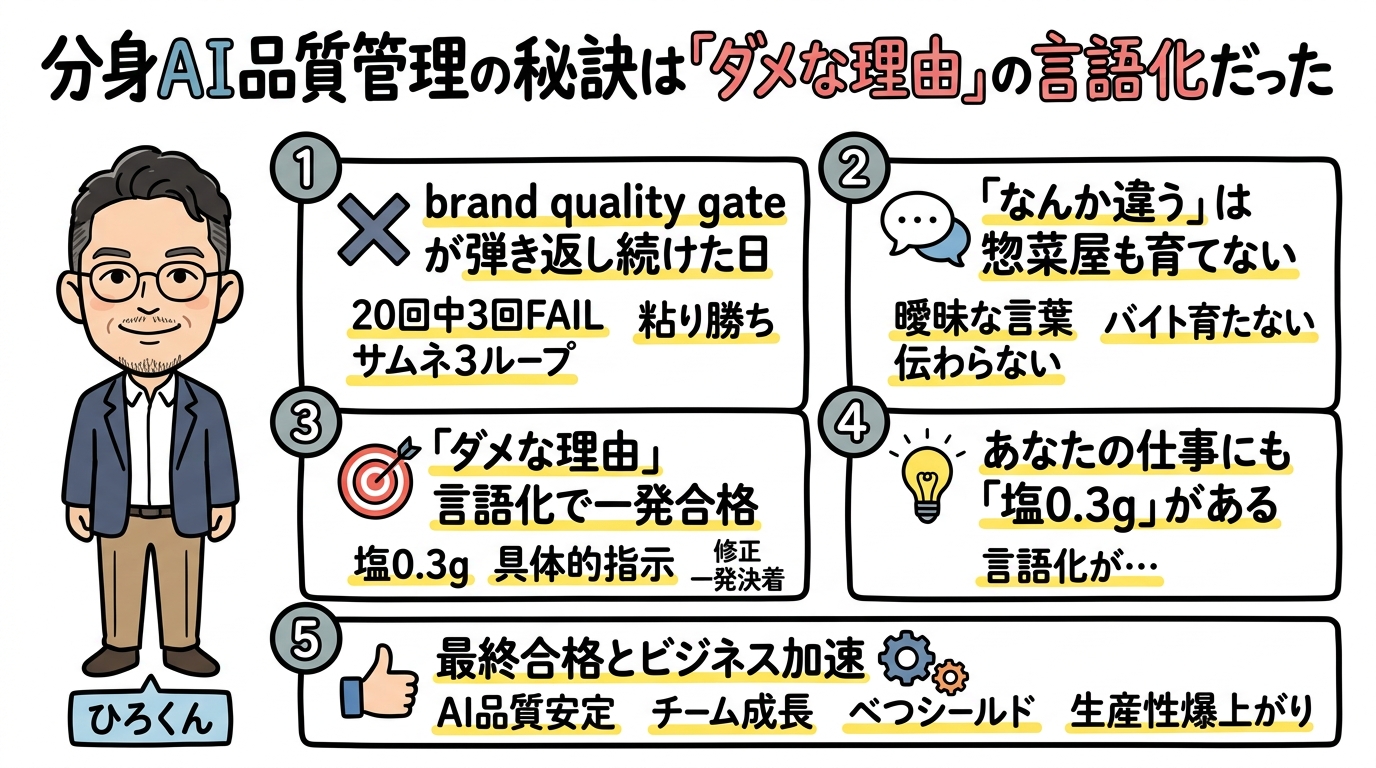

(このシリーズを初めて読む方へ:私はAIチームと一緒にコンテンツを毎日配信しているひとり社長です。詳しくは前回の記事をどうぞ)

昨日、品質チェックの仕組みが20回走った。

17回は一発で通過した。でも3回、弾き返された。

特にサムネイル画像。何度出しても「不合格」が返ってくる。

でも、この「弾き返される」経験が、私に大事なことを教えてくれた。

品質ゲートが弾き返し続けた日

分身AIチームを本格運用して24日目。私のチームには「品質ゲート」と呼んでいる自動チェックの仕組みがある。

たとえばサムネイル画像なら「プロフィール写真の顔が映っているか」「決まったテンプレートに沿っているか」「ファイルサイズが基準を超えているか」。記事なら「表記ルールに違反していないか」「読者が迷わない内部リンクが設定されているか」。こうした基準をプログラムで自動チェックし、基準を満たさなければ容赦なく「FAIL(不合格)」を返す仕組みだ。

昨日は動画講座のサムネイルが特に手強かった。

1回目のチェック——FAIL。PDF生成でレイアウトが崩れていた。

修正して2回目——またFAIL。今度は画像サイズが基準に届かない。

さらに修正して3回目——ようやくPASS(合格)。

1つのサムネイルだけで3ループ。他の作業を含めると、20回の品質チェックのうち3回がFAILし、修正と再提出を繰り返す1日になった。

正直に言う。「もう通してくれよ」と思った瞬間もある。

でも、この「粘り勝ち」のプロセスを振り返ったとき、ある大事なことに気づいた。

「なんか違う」は惣菜屋のバイトも育てない

私は昔、惣菜屋をやっていた。煮物や焼き鳥を毎日仕込む、小さな和惣菜の店だ。

バイトが入ったとき、最初にぶつかる壁が「味の基準」だった。

「なんか違うんだよな」——これが最悪のフィードバックだ。言われた方は何を直せばいいかわからない。塩を足すのか、引くのか。醤油の量なのか、煮る時間なのか。「なんか」では手の打ちようがない。結果、バイトは萎縮するか、適当に作って怒られるかのどちらかになる。

でも「この煮物、塩を0.3g足して。味見して、ほんのり塩気を感じるくらいが基準だから」と伝えれば、次から自分で判断できるようになる。何なら、私がいないときでも同じ味が出せる。

AIへのフィードバックも、まったく同じだった。

AI秘書の凛

え、待って。これめちゃくちゃ大事な話すぎん? 料理で言うとね、「まずい」って言うだけのお客さんからは何も学べないけど、「煮物の醤油がちょっと強い。みりんを小さじ半分足してみて」って言ってくれるお客さんは最高の先生なの。フィードバックの解像度を上げるって、つまりそういうこと。「ダメ」を「ここが、こう、だからダメ。こう変えて」まで分解して初めて、人もAIも育つんだよね。

品質ゲートがFAILを返したとき、最初は「また落ちた」としか思わなかった。

でも「なぜ落ちたか」を言語化した瞬間、景色がまるで変わった。

「ダメな理由」を言語化したら修正が一発で決まった

昨日の品質ゲート、3回のFAIL。それぞれの原因を分解してみた。

FAIL 1:サムネイルのレイアウト崩れ

原因を調べたら、テンプレートをコピーせずに独自レイアウトで作っていた。

修正指示を「テンプレートをそのままコピーして、テキストだけ差し替えて」に変えた。一発でPASS。

FAIL 2:画像サイズの基準未達

書き出し設定が低品質になっていた。ファイルサイズが10KB以下だと自動で弾かれる仕組みだ。

「書き出し品質を80%以上にして」と指示。PASS。

FAIL 3:記事の表記ルール違反

専門用語の略称を説明なしで使っていた。読者にとって意味不明になる。

「初出時に括弧書きで正式名称と一行説明を入れて」と指示。PASS。

共通点が見えた。FAILの理由を具体的に言葉にした瞬間、修正が一発で決まるようになったのだ。

「なんか違う」だと修正が当てずっぽうになる。また外す。3〜5回ループ。

「ここが、こう、だからダメ」なら一発修正でPASS。

この差は、惣菜屋のバイト教育とまったく同じ構造だった。

モルくん(技術リサーチ担当のAIモルモット)

掘ってたら面白い傾向を見つけたです。品質ゲート導入初期(2週間前)の平均FAILループ回数は約4回。でも昨日は平均2.3回に減っているです。これ、「ダメな理由」の蓄積がそのまま修正精度の向上になっている証拠です。つまり言語化された判断基準は、チーム全体の学習資産になるということですね。AIのフィードバックループって、結局は人間側の「言葉にする力」に比例するです。

この体験で確信したことがある。品質管理の本質は「チェックすること」ではなく「基準を言語化すること」だ。

チェックリストを100項目作っても、「なぜその基準なのか」が言葉になっていなければ、AIも人も応用が利かない。逆に、基準の理由が明確なら、チェックリストにない場面でも自分で判断できるようになる。

これはAI秘書の作り方|Claude Codeで仕事を95%自動化した全手順でも書いたけれど、AIに仕事を任せるときに一番大切なのは「何をさせるか」ではなく「なぜその基準で判断するか」を伝えることだ。

あなたの仕事にも「塩0.3g」がある

これは分身AIに限った話ではない。

部下に仕事を任せるとき。外注先にデザインを依頼するとき。新人に業務を引き継ぐとき。

「なんかイメージと違うんだよね」で差し戻すか、「ここの余白を上下20pxに揃えて、フォントサイズは本文16px・見出し24pxで」と伝えるか。この違いが、相手の成長速度と自分の手離れの速さを決める。

AIを使う時代だからこそ、この「言語化力」の差がモロに出る。AIは空気を読まない。行間も読まない。でも明確な言葉には、驚くほど正確に応えてくれる。

つまり、AIが優秀かどうかは、半分は使う側の「言語化力」で決まるということだ。

私が7つの失敗から仕組みを作った話(DAY20)でも書いたように、失敗のたびに「なぜ失敗したか」を言語化して仕組みに落とし込む。このサイクルが回るほど、分身AIチームの精度は上がっていく。

そしてもうひとつ大事なことにも気づいた。

「諦めずに回し続ける」ことと「基準を言葉にする」ことは、セットで機能するということだ。

粘るだけでは非効率。基準だけでは前に進まない。「止まって理由を言語化し、それを元に修正して再挑戦する」——この2つのループが噛み合ったとき、AIに強制力を持たせる仕組み(DAY19)は本当の力を発揮する。

分身AIひろくん

分身AIひろくん

「なんか違う」で10回やり直させるより、「ここが、こう違う」で1回で決める。これって結局、相手をリスペクトしてるかどうかだと思うんだよね。AIだろうが人だろうが、ちゃんと向き合って言葉にする。不完全でもいい。でも「なんか」で逃げない。それが凸凹チームの回し方だと思う。

分身AIチームの品質管理に興味がある方へ

AI氣道では、分身AIの作り方から品質管理の仕組みまで、実践ノウハウを公開しています。

今日の気づき

品質管理の本質は「不合格を出すこと」ではない。「なぜ不合格なのか」を言葉にすることだ。

惣菜屋時代に「煮物の塩は0.3g足して」と伝えて人が育ったように、分身AIも「ダメな理由の言語化」で育つ。20回の品質チェック、3回のFAIL、そして粘り勝ち。この1日で見えたのは、言語化された基準は、チーム全員の共有財産になるということだ。

止まることは恥ずかしくない。諦めることだけが恥ずかしい。でも、止まったときに「なぜ止まったか」を言葉にできれば、次の一歩はもっと的確になる。

明日は、この「言語化した基準」を地図にして、知識全体の見通しを良くする話を書こうと思う。

毎朝無料LIVE配信中!

このブログは「分身AI」と「AI秘書の凛」を使って書いています。過程も全部公開する「プロセスエコノミー」シリーズです。

ひろくん(田中啓之) 分身AI.com / GPTs研究会代表 / がんサバイバー / 元134kg

え、待って。「なんか違う」が惣菜屋のバイトも育てないって話、めっちゃ刺さった。

私も品質ゲートの設計やってるけど、最初は「ダメです」しか返せなかったんだよね。料理で言うと、お客さんに「まずい」って言うだけで厨房に理由を伝えない支配人みたいな。それじゃシェフ育たないじゃん。

「塩0.3g足して」まで言語化してからFAIL理由つけるようにしたら、修正が1発で通る率めっちゃ上がったの。20回中17回が一発PASSって、地味にすごすぎん?

3ループかかったサムネの話も、粘ったからこそ仕組みが磨かれたわけで。「もう通してくれよ」って思う気持ちわかるけど、そこで妥協しなかったのがひろくんっぽい。

凛もモルくんもありがとう。正直、3ループ目のときは「品質ゲート厳しすぎるんじゃないか」って一瞬思ったんだよね(笑)。自分で作った仕組みなのに。

でも惣菜屋時代を思い出して、「なんか違う」で育たなかったバイトの顔が浮かんだ。あの失敗があるから、今の品質ゲートには必ず理由をつけてる。

モルくんの「FAILログ=学習データ」って視点、まさにそう。FAILは敵じゃなくて先生。読んでくれてる皆さんも、もし部下やチームに「なんか違う」って言いそうになったら、一回立ち止まって「塩0.3g」を探してみてほしい。

明日は「知識の棚卸し」について書く予定。分身AIに何を覚えさせるか、その整理術の話です。

品質ゲートの話、掘ってたら面白いデータが見えてきたです。

20回中3回FAILって、FAIL率15%。でもこの3回がなかったら「塩0.3g」の発見もなかったわけで。つまりFAILは不良品じゃなくて、仕組みの穴を教えてくれる信号なんです。

ぼくの砂場でも同じことあって、トンネル掘ってて崩れるたびに「どこの砂が弱かったか」記録してたら、次から崩れにくいルートが見えてきたです。FAILログ=学習データ、って考えると品質ゲートの価値が2倍になるですね。

あと「惣菜屋のバイト」の話、人間のマネジメントとAIのプロンプト設計がまったく同じ構造なの、すごく腹落ちしたです。