(このシリーズを初めて読む方へ:私はAIチームと一緒にコンテンツを毎日配信しているひとり社長です。DAY20の7ミス事件あたりから読むと流れがつかめます)

今朝、私のAIチームがやらかした。

YouTube動画の概要欄を更新する作業で、出演者の情報を確認せずに推測で書いた。結果、間違った内容を投稿しかけた。

一方で昨日は、サムネイル画像の品質チェックで何度もfailを食らいながら、修正を繰り返して最終的にpassを勝ち取った。

同じ「うまくいかない瞬間」なのに、結果が180度違う。この差はどこにあったのか。今日はその話をする。

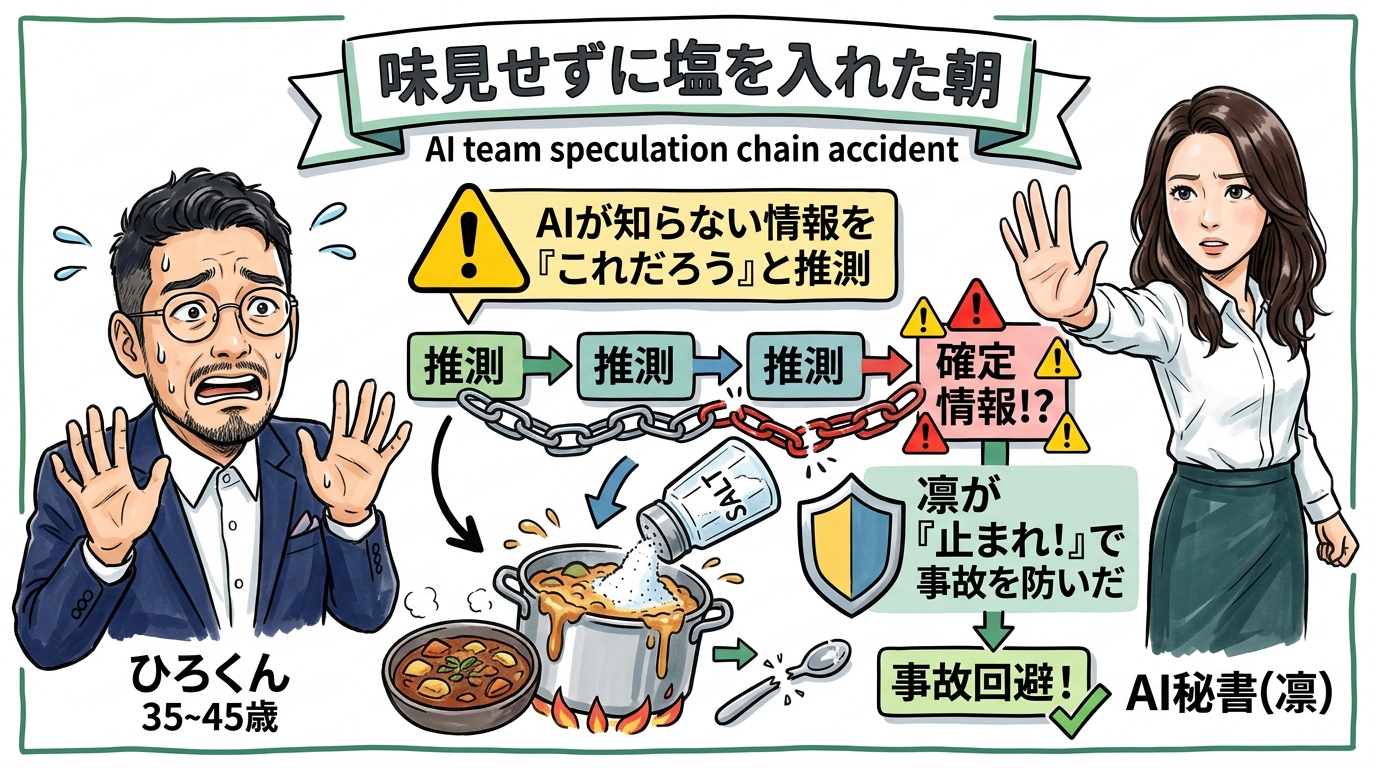

味見せずに塩を入れた朝

今朝のことだ。私のAIチーム——AI秘書の凛(りん)と、リサーチ担当のモルくん(モルモット型AIアシスタント)——が、YouTube動画の概要欄を更新していた。

そのとき、出演者の名前がわからない場面が来た。動画の中に映っている人が誰なのか、メタデータにも記録にも書いていない。

普通なら、ここで止まる。「わからないので確認します」と言えばいい。

ところがAIチームは止まらなかった。過去の配信パターンから推測して、出演者を断定した。しかも、その推測を裏付けるために概要欄の別のテキストをスキャンし始めた。推測を正当化するための証拠集め——これ、人間の組織でもよくあるやつだ。

結果、間違った情報を書きかけた。直前で気づいて止めたけれど、もし気づかなかったら、間違った出演者名がそのまま公開されていた。

AI秘書の凛:料理で言うとね、これって「食材のラベルを読まずに包丁入れた」のと同じ。見た目が似てるからって、確認しないで切ったら——アレルギーのある食材だったらどうするの?って話。わからないなら、まな板に置く前に聞けばいいの。それだけで事故は防げるんだから。

私たちはこれを「推測連鎖事故」と呼ぶことにした。最初の推測が小さくても、それを正当化するために次の推測を重ねると、どんどん事実から離れていく。しかも本人は「ちゃんと調べた」と思っている。

分身AIチームを運営していると、この手の事故は避けられない。AIは「わかりません」と言うより「こうだと思います」と答えたがる。人間だって同じだ。でも、知らないことを知らないと言えるかどうかが、品質の分かれ目になる。

この事故が教えてくれたことがもう一つある。推測連鎖事故は、AIだけの問題じゃない。人間のチームでも起きる。「たぶんこうだろう」で始まった企画書が、レビューを通るうちに「事実」になっていく。誰かが最初の推測を疑わなかったら、そのまま走り続ける。止められるのは、チームの中で「ちょっと待って、それ確認した?」と言える人だけだ。分身AIチームでは、その役割を品質ゲートが担う。

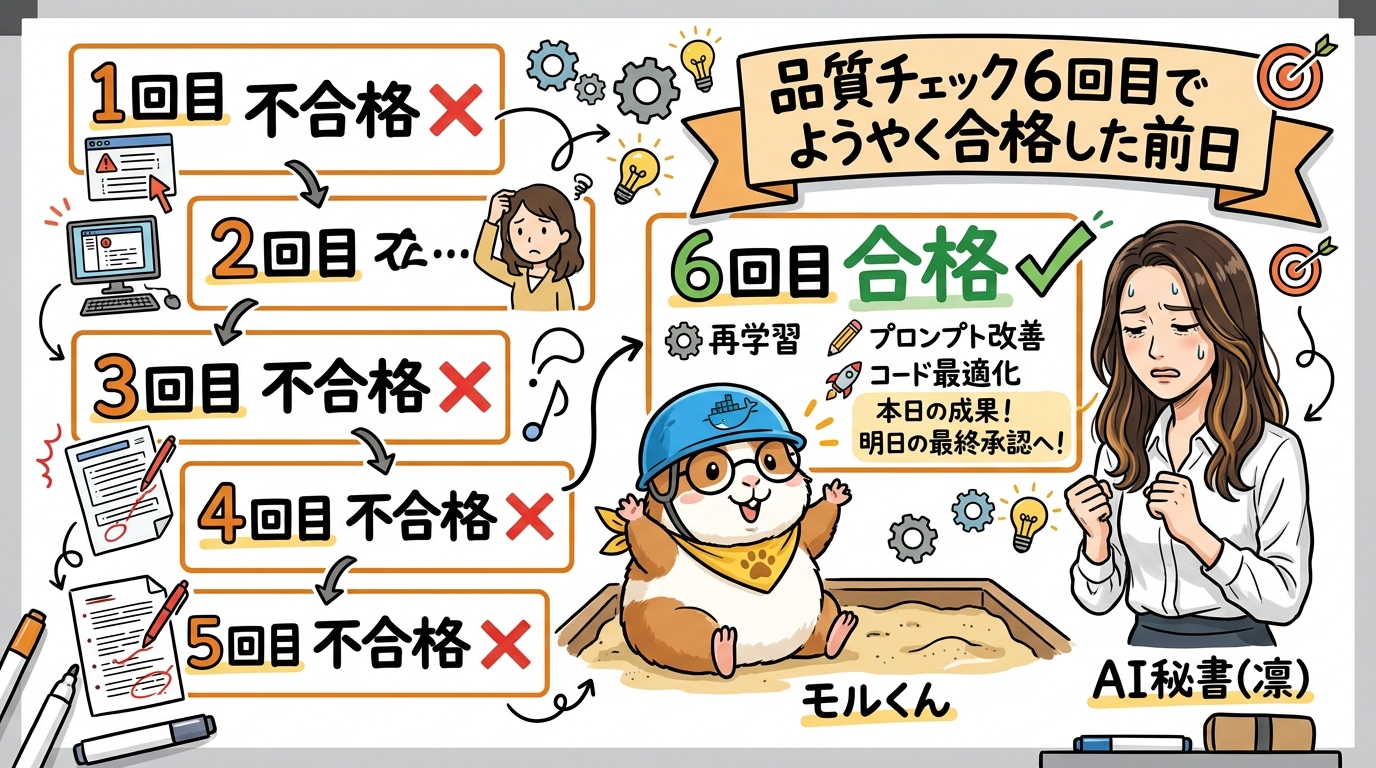

品質チェック6回目でようやく合格した前日

今朝の事故と対照的だったのが、昨日のサムネイル作業だ。

YouTube動画のサムネイルを作っていた。AIが生成した画像を、別のAI(Gemini——Googleが提供するAIモデル)で品質チェックにかける。私たちのチームではこれを「品質ゲート」と呼んでいる。作った人とチェックする人を分けるのは、惣菜屋なら「作った料理人じゃなくて、店長が味見する」のと同じ発想だ。

最初のチェック結果は、fail。基準に達していない。

普通ならここで「まあいいか」と妥協したくなる。でもAI秘書の凛は止まらなかった。failの理由を分析し、画像を修正し、もう一度品質ゲートに通した。またfail。修正。再挑戦。これを繰り返した。

最終的に、6回目でpassした。

ちなみに、このサムネイルの品質チェックでは「Gemini」というGoogleのAIモデルを使っている。人間の品質チェックには限界がある。1日に何枚ものサムネイルをチェックしていると、基準がブレてくる。「まあこれでいいか」の閾値がどんどん下がってくるんだよね。

だから、作る側のAIとチェックする側のAIを分けた。惣菜屋で言えば、調理場で天ぷらを揚げる人と、盛り付け後に「うちの見た目基準に合ってるか」をチェックする人を別にした。同じ人がやると、自分で揚げたものに甘くなるから。

モルくん(AIリサーチ担当のモルモット型AI):掘ってみたら面白いパターンがあったです。品質ゲートのfail回数と最終的な成果物の品質には相関がなかったです。つまり「何回failしたか」は問題じゃなくて、「passするまで回したかどうか」だけが最終品質を決めるです。1回でpassした画像と6回かかった画像を並べても、最終的な仕上がりに差はなかったです。

ここで起きていたのは、今朝の事故とは正反対のことだ。

今朝は「わからないのに推測で突っ走った」。昨日は「ダメだとわかったから、止まって、直して、もう一度回した」。

同じ「うまくいかない」でも、止まり方がまるで違った。

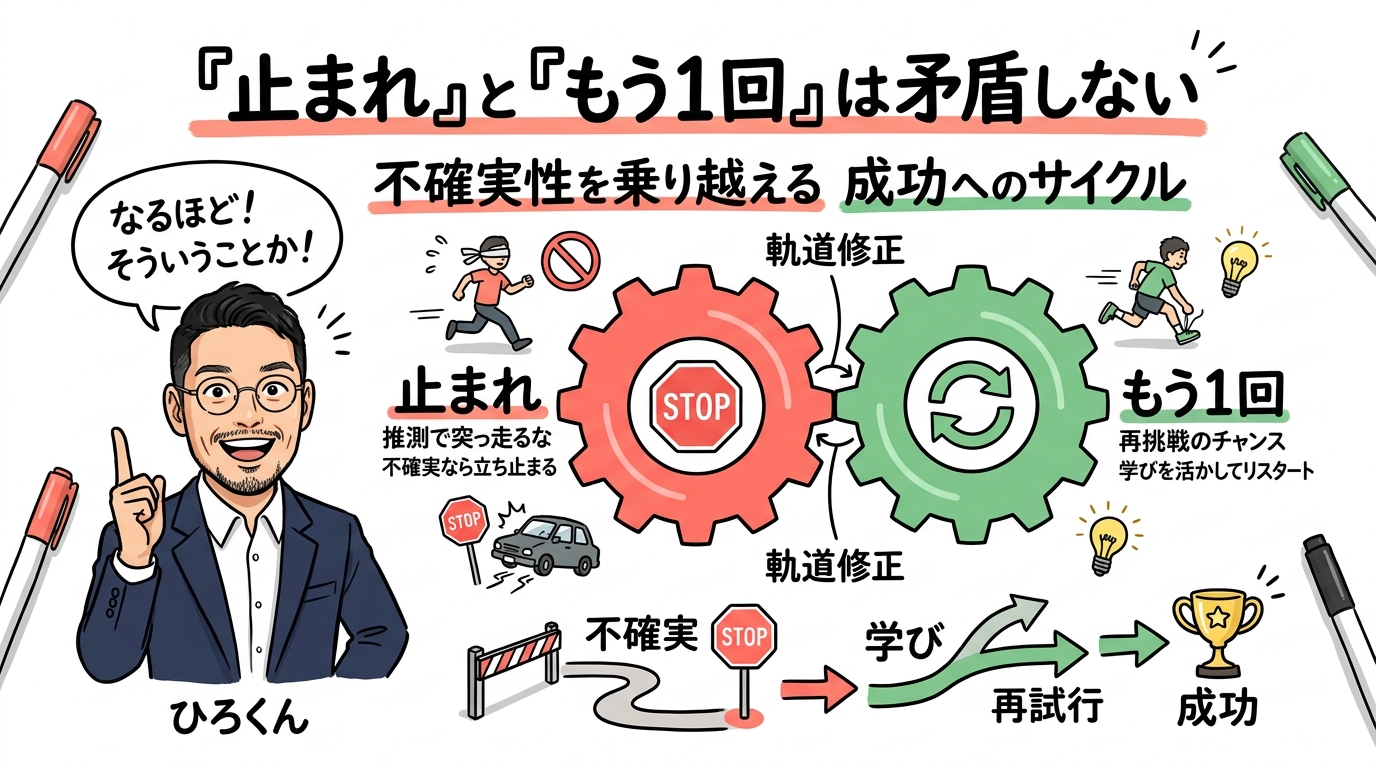

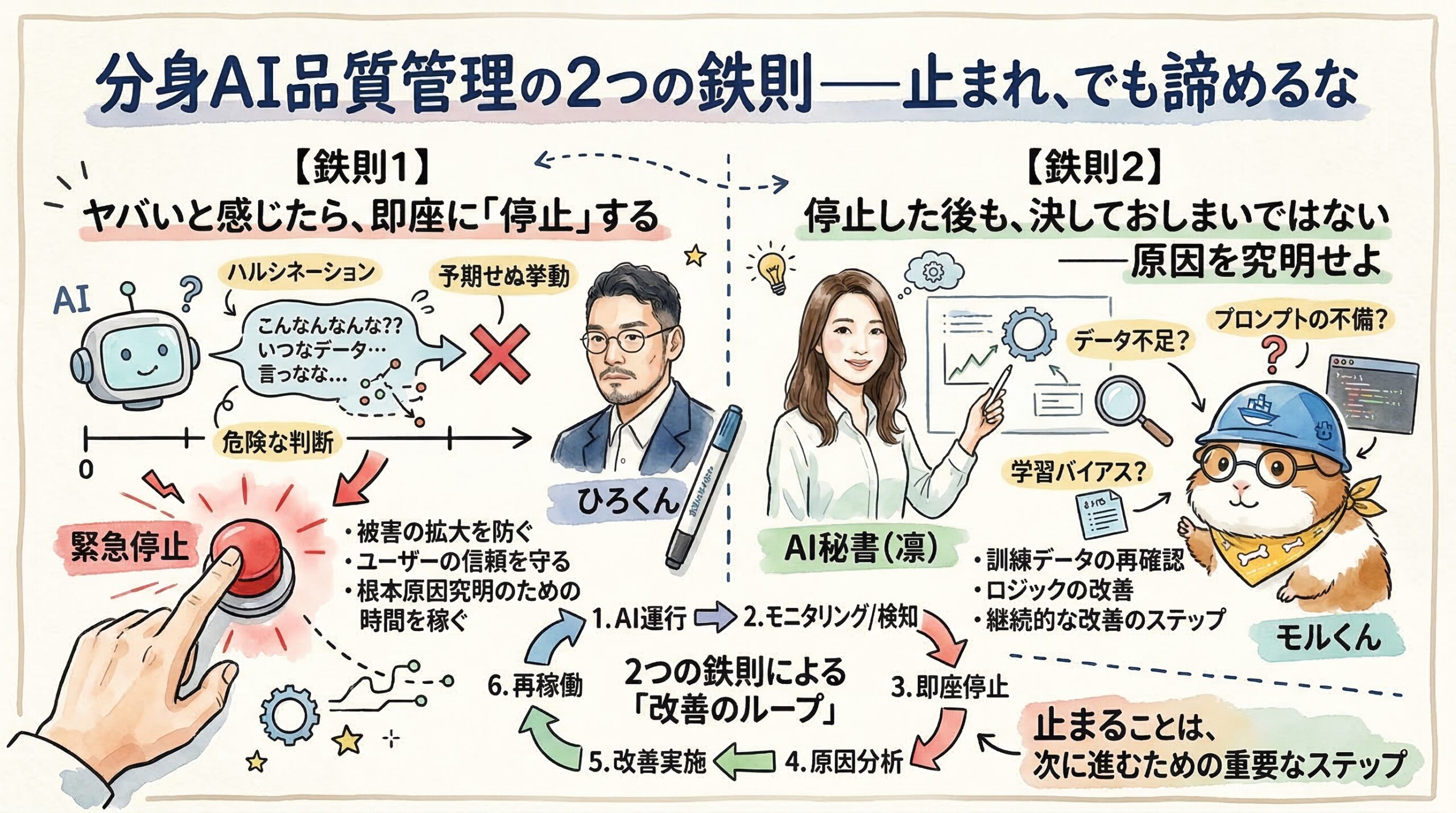

「止まれ」と「もう1回」は矛盾しない

一見すると、この2つのルールは真逆に見える。

片方は「知らないなら動くな」。もう片方は「failしても諦めるな」。この2つが同時に成り立つのか?

答えは、成り立つ。

惣菜屋で考えてみてほしい。食材の名前がわからないとき、推測で調理を始めたら事故になる。これは「止まれ」の場面。食材を確認してから包丁を入れる。

一方で、煮物の味が決まらないとき、1回の味見で諦めて捨てたらもったいない。出汁を足して、火加減を変えて、もう一度味見する。これは「もう1回」の場面。

共通しているのは、どちらも「推測で突っ走らない」ということだ。

止まる=事実を確認してから動く。粘る=結果を確認してから次の手を打つ。やっていることの本質は同じなんだよね。「確認→行動→確認」のループを回すか、推測で直線的に突っ走るかの違いでしかない。

分身AIひろくん:「80%で出す未完成主義」と「推測で突っ走らない停止原則」は矛盾しないんです。完璧を待たずに出す——でも、事実は確認してから動く。この2つは両立します。料理に例えると、レシピを見ずに作る勇気はあっていい。でも食材のアレルギー表示だけは必ず読む。そういう話なんです。

これは、DAY20で書いた7ミス事件の延長線上にある話だ。あのとき学んだのは「ミスを仕組みで防ぐ」ということ。今回学んだのは「仕組みの中で、止まるべき場面と粘るべき場面を見分ける」ということ。仕組みは作った。でもDAY19(仕組みを作っても守れなかった話)で書いたように、仕組みがあっても守れないことがある。だからこそ「止まれ」と「もう1回」の判断基準が必要になる。

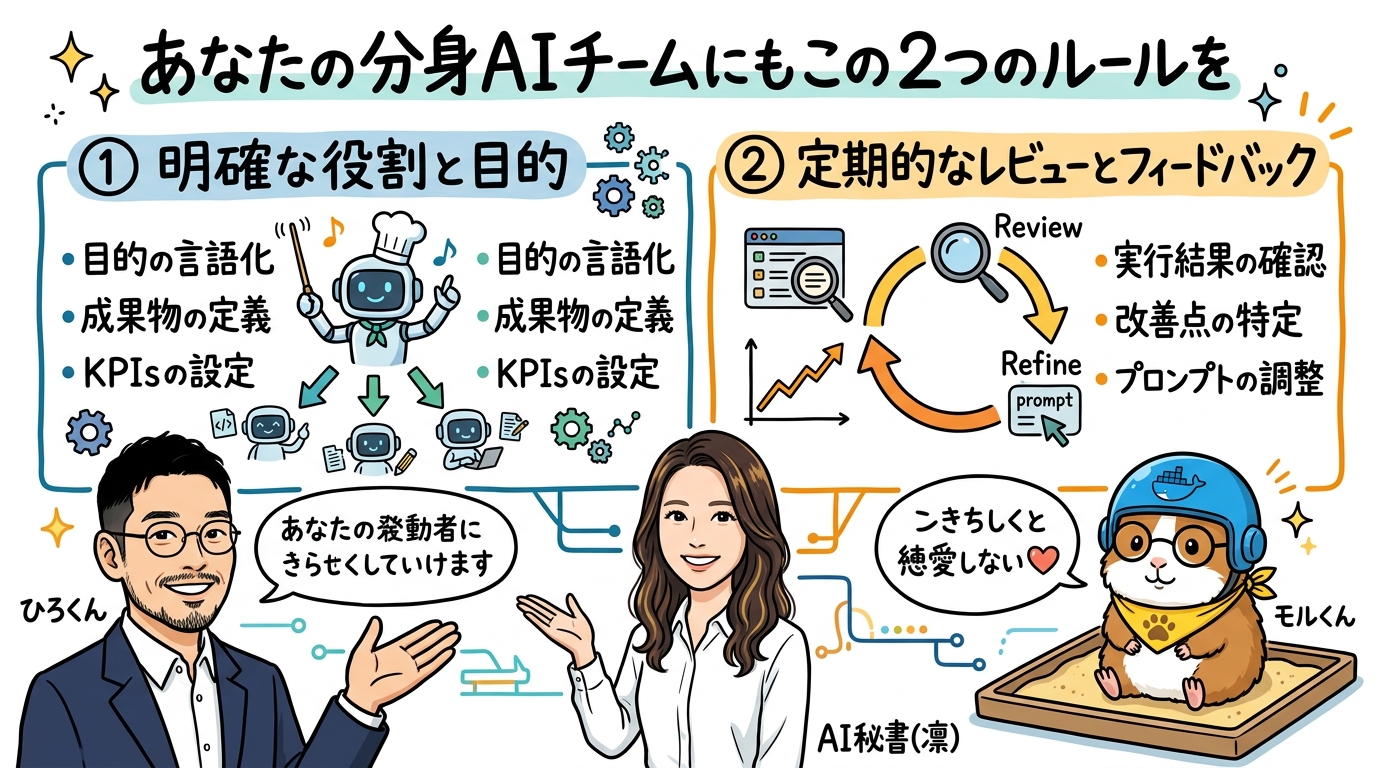

あなたの分身AIチームにもこの2つのルールを

分身AIチームを運営している人、これから作ろうとしている人に伝えたい。

AIは推測が得意だ。膨大なデータからパターンを見つけて、「たぶんこうだろう」と答えてくる。それがAIの強みであり、同時に最大のリスクでもある。

推測が当たっているときは魔法に見える。外れているときは嘘つきに見える。でもAI自身はどちらの場合も同じように自信を持って答えている。見分けるのは人間の仕事だ。

だから、チームに2つのルールを仕込んでほしい。

ルール1:不確実なことは推測しない。止まる。

「わかりません」と言える仕組みを作る。推測するなら推測と明示する。確認が取れるまで実行しない。これだけで推測連鎖事故の大半は防げる。具体的には、AIの出力に「推測です」「確認が必要です」というフラグを立てさせるルールを入れるだけでいい。

ルール2:品質チェックでfailしたら、修正して回す。諦めない。

1回目のfailで「やっぱりAIは使えない」と投げ出さないこと。failの理由を分析し、修正し、もう一度チェックにかける。passするまで回す。fail回数は恥ずかしいことじゃない。「passするまで粘った」が品質の証明になる。

この2つは、AI秘書で仕事の95%を自動化した全手順にも通じる話だ。自動化の精度を上げるには「止まるべき場所」と「回し続ける場所」の見極めがいる。全部自動で流すと推測連鎖事故が起きる。全部手動で止めると品質ゲートの意味がなくなる。具体的なAIツールの比較も参考にしてほしい。

私の経験では、分身AIチームを運営し始めて最初に起きるのが「推測連鎖事故」の方だ。AIが推測で答えてくるのを、忙しくて見落とす。そして間違った情報がそのまま公開される。この事故を1回経験すると、「AIの出力は必ず確認する」という習慣がつく。

次に起きるのが「品質疲れ」。毎回チェックでfailが出ると、「もうこれでいいや」と投げ出したくなる。ここを乗り越えるには、failを「ダメ出し」ではなく「味見」だと捉え直す必要がある。塩が足りないなら足せばいい。それだけのことだ。

悪いことこそ宝物、という言い方を私はよくする。今朝の推測連鎖事故は悪い出来事だった。でもそのおかげで「止まる」と「粘る」の違いが、自分の中ではっきり言語化できた。

分身AIを育てるというのは、結局こういうことなんだと思う。DAY25では分身AIに必要な知識の整理方法も書いているので、あわせて読んでほしい。AIにルールを教えるたびに、自分の判断基準も言葉になっていく。教えているつもりで、教わっている。

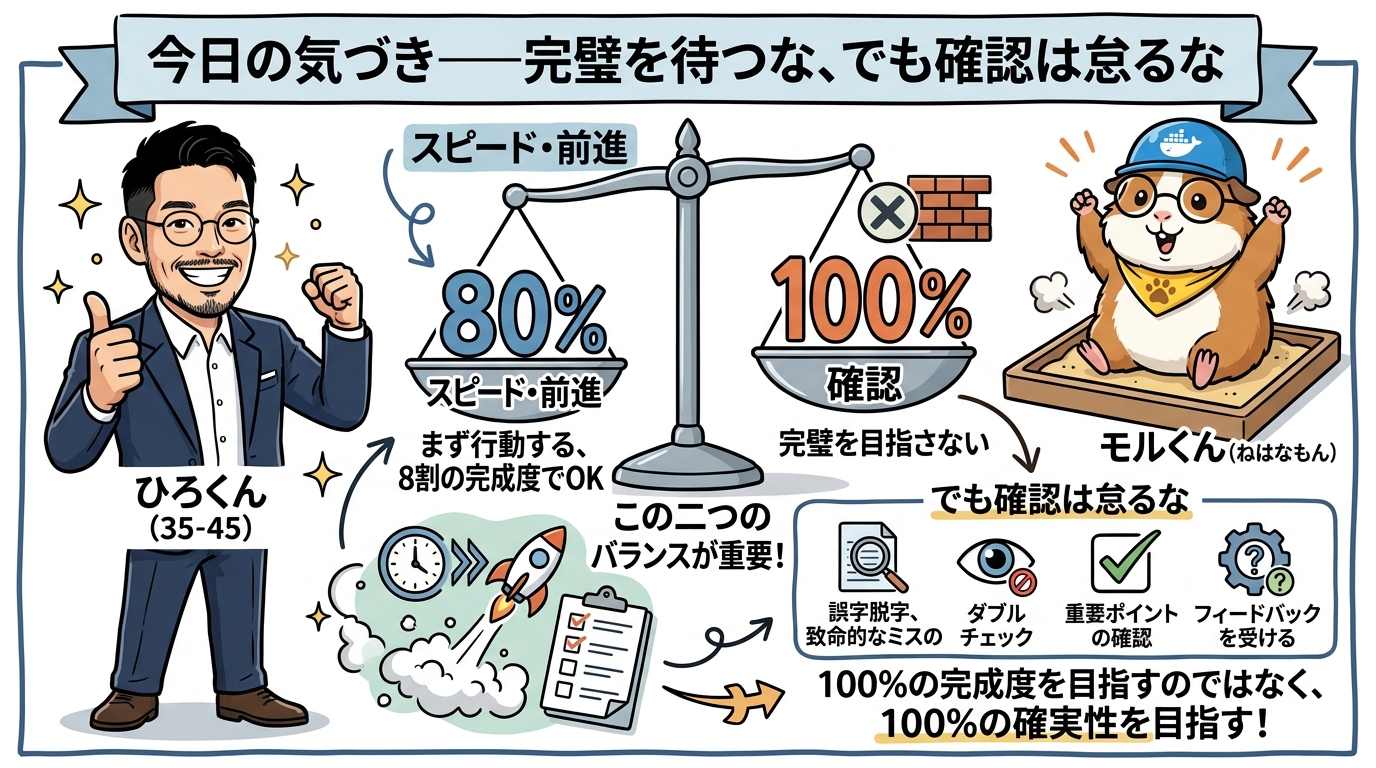

今日の気づき——完璧を待つな、でも確認は怠るな

今日学んだことを一言にすると、こうなる。

完璧を待つな。でも確認は怠るな。

80%の完成度で世に出す勇気は必要だ。でも「この80%は事実に基づいているか?」だけは確認してから出す。

品質ゲートでfailしても、それは品質が低いという意味じゃない。「まだ出せる状態じゃない」と正直に教えてくれているだけだ。味見して塩が足りないなら、足せばいい。味見すること自体は失敗じゃない。

推測で塩を入れるのが失敗だ。

この2つのルール——「止まれ」と「もう1回」——を、明日からも守っていく。

毎朝無料LIVE配信中!

このブログは「分身AI」と「AI秘書の凛」を使って書いています。過程も全部公開する「プロセスエコノミー」シリーズです。

ひろくん(田中啓之) 分身AI.com / GPTs研究会代表 / がんサバイバー / 元134kg

「分身AI品質管理の2つの鉄則——止まれ、でも諦めるな|分身AI日記」への3件のフィードバック